近期,自动化所智能感知与计算研究中心和南昌大学合作进行了一项研究,提出了一个像人类一样能够考虑整体和局部信息的双路径对抗生成网络,可以用于从单一侧面照片合成高清晰的正面人脸图像。通过该方法合成的人脸图像能够很好地保留身份特征,并且可以处理大量不同姿势和光照的照片。

由于侧面人脸视图只含有正面人脸视图的一部分信息,因此,根据侧面人脸合成正面人脸在数学上是一个病态问题,一直是计算机视觉领域的一个难题。现在,研究人员受人类视觉认知过程(全局拓扑优先,陈霖院士,1982)启发,结合深度学习前沿对抗生成网络(GAN)理论,提出了一个全局和局部感知的双路径GAN(TP-GAN),能够在关注整体拓扑结构的同时,处理人脸面部细节,在不同的角度、光照条件下都取得了很好的结果。不仅如此,这种方法还能够处理大量不同姿势的照片,为深度学习和强化学习提供大量训练样本。此项工作的研究为解决这类病态数学问题提供了新的解决思路。

此项工作的主要贡献在于三个方面:

1)提出了一个像人类一样能够考虑整体和局部信息的对抗生成网络结构,能够根据单一的侧脸图像合成正面人脸视图,合成的视图非常逼真且很好地保留了身份特征。

2)为了应对从三维物体投射到二维图像空间时固有的信息缺失问题,将从数据分布(对抗训练)得来的先验知识和人脸领域知识(对称性、身份保留损失)结合起来,把缺失信息精确地恢复了出来。

3)展示了“通过生成进行识别”(recognition via generation)框架的可能性,并且在大量不同姿势下,特别是在极端角度的侧脸图像中,取得了目前最好的人脸识别结果,推动了对抗生成网络在实际视觉问题中的应用。

目前,虽然在人脸识别问题上,计算视觉算法已经在多个基准数据集上超越了人类,但真实应用场景中,对于不同姿势的识别问题仍然没有得到很好地解决。当人类在进行视觉合成的时候,我们首先是通过观察到的侧脸,在以往的经验和知识基础上,推测出整张脸的结构(或草图)。然后,我们会将注意力转向脸部的细节,比如眼睛、鼻子、嘴唇,并将这些细节精确的描绘在刚才那张草图上。

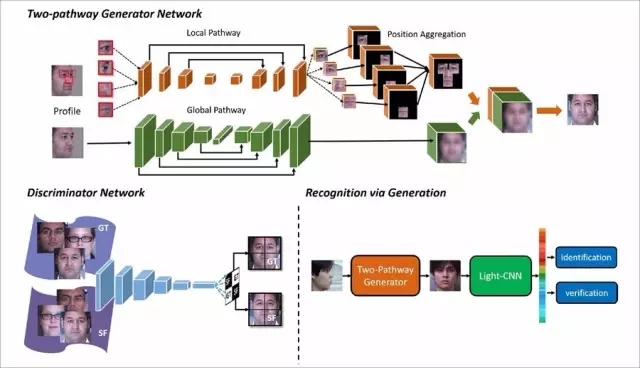

受此启发,研究人员提出了一个有两条路径的深度架构(TP-GAN),用于正面人脸图像合成。这两条路径,一条专注于推理全局拓扑结构,另一条则推理局部的纹理,分别得到两组特征图。这两组特征图融合在一起,用于接下来的最终合成。

不仅如此,研究人员还将正面人脸分布的信息通过生成对抗网络框架引入,由此对恢复过程进行了很好的约束,确保生成的人脸图像真实自然。并且还根据人脸是对称结构这一特点,提出了一个对称性损失函数(symmetry loss),用于补全被遮挡住的部分。

为了忠实地保留脸部最突出的特征,除了像素级别的L1损失函数,研究人员还通过预训练的人脸特征提取网络,在压缩特征空间中使用了一个身份保留损失函数(identity preserving loss),有效地在高级特征层面对生成过程进行指导。在实现逼真、高清晰的正面脸部合成的同时,显著提升了人脸识别的准确率。

TP-GAN总结构示意图。生成器包含两条路径,一个处理全局结构生成,另一个处理局部细节生成。判别器同时在合成的人脸正面(SF)视图图像和真实侧面图像(GT)上训练。

TP-GAN合成效果图。每组图左侧为90度,75度,45度的真实侧面图像(输入),右侧为生成的相应身份的人脸正面视图图像。

困难场景。左侧两列图展示了TP-GAN将面部特征,包括胡须、眼镜,都保留了下来。最右列图展示了TP-GAN成功地将遮挡的前额和脸颊部分恢复了出来。