2023年9月7日,创刊百年的《时代》周刊发布人工智能领域最具影响力100人(TIME100/AI)。这份榜单包括“领导者(Leaders)”、“创新者(Innovators)”、“塑造者(Shapers)”、“思想者(Thinkers)”。中国科学院自动化研究所曾毅研究员入选其中全球25位“思想者(Thinker)”。

下附《时代周刊(TIME)》TIME100/AI对曾毅研究员专访主要内容翻译:

作者:Will Henshall (《时代周刊(TIME)》Aditorial Fellow)

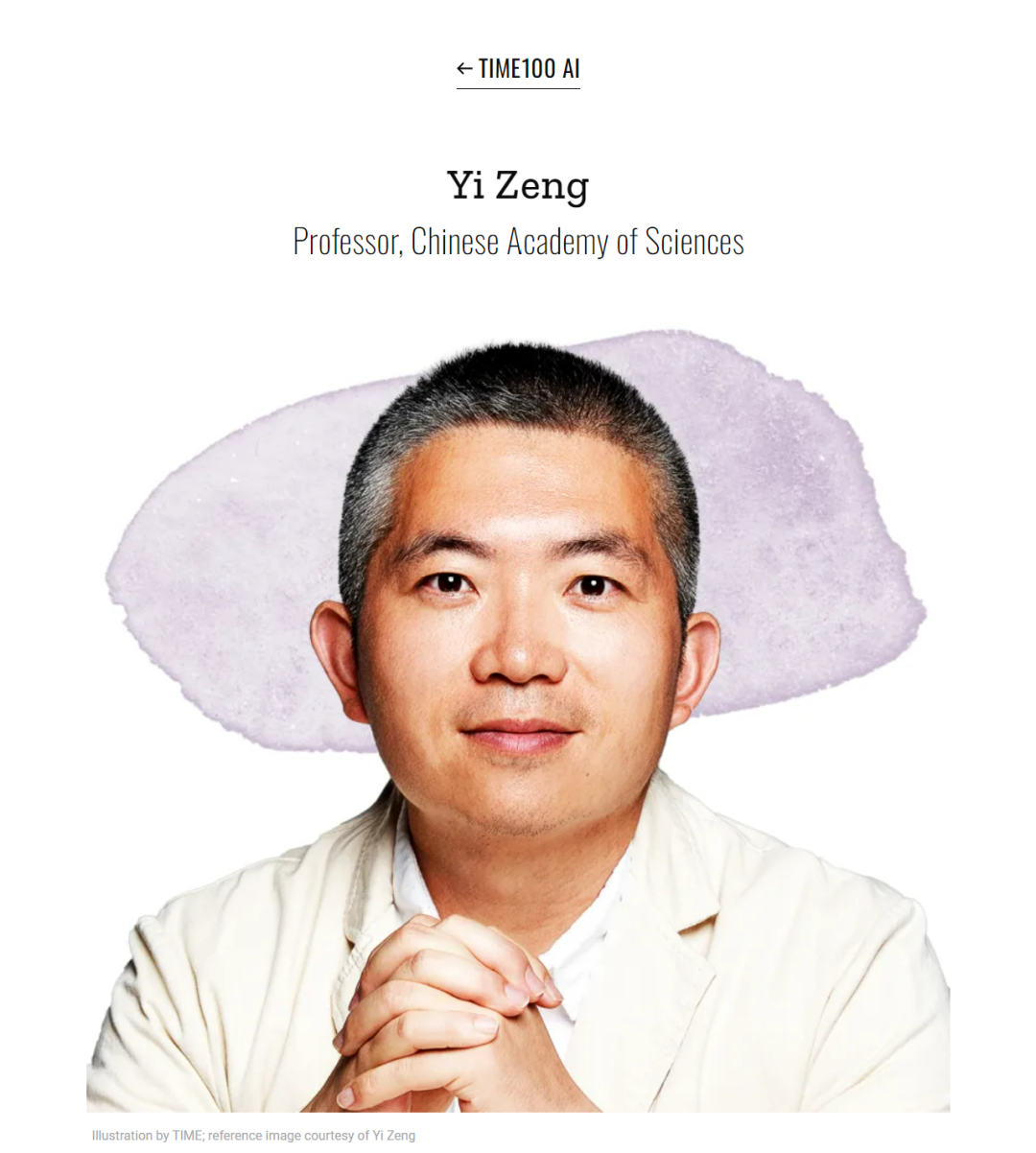

史蒂文 斯皮尔伯格(Steven Spielberg)2001年的电影《人工智能(Artificial Intelligence)》中,两名研究人员正在讨论模拟人脑以构建具有爱的机器人。这一场景激发了当时正在北京读大学的曾毅的灵感。“这就是我想要[用我的]一生去做的事情。也就是说,构建能够爱人类的机器人”他告诉《时代周刊(TIME)》,此时他正在中国首都北京与我对谈。曾毅,41岁,一直在中国科学院担任研究员,致力于构建“类脑人工智能”——尽可能与人脑相似的人工智能系统,希望它们拥有道德。

大约在2016年,曾毅对人工智能系统带来的风险更加担忧,他开始花更多时间与政策制定者合作,以发展有益的人工智能(Beneficial AI)。三年后,曾毅领导的团队撰写了《人工智能北京共识(Beijing AI Principles)》。他告诉《时代周刊(TIME)》,他“通过国家新一代人工智能治理专委会深度参与政策制定”。

曾毅还推动了诸多国际合作。“我觉得我有责任让世界知道,来自中国的科学家和政策制定者真的有着类似的想法”他说。他参与制定了《联合国教科文组织人工智能伦理建议书》,并参与了许多非正式的国际科技外交倡议,如跨文化人工智能伦理与治理国际研讨会,并最近在联合国安全理事会(UN Security Council)的会议上发表讲话。

曾毅认为,就对人工智能风险的态度而言,这中国和美国有很多共同之处。最近的一项民意调查发现,62%的美国选民担心人工智能,而只有21%对其感到兴奋。作为他在北京的远期人工智能中心(Center for Long-term AI)的部分工作,曾毅对中国公众进行了调查,发现91%的受访者支持对人工智能模型实施强制性的安全和伦理框架。他说:“我们没有选择,我们必须合作”。